Bias (keberpihakan) dalam Pembelajaran Mesin

Memahami bentuk bias ML dan cara menghindarinya.

Keadilan dalam Pembelajaran Mesin

Sejauh ini, kursus ini menunjukkan cara pembelajaran mesin (ML) dapat meningkatkan pekerjaan Anda, dari menghemat waktu yang berharga untuk tugas yang ada hingga membuka peluang baru. ML dapat melakukan banyak hal untuk Anda, tetapi ia hadir dengan tantangan yang tidak boleh Anda abaikan.

Untuk mengatasi tantangan tersebut, semakin banyak peneliti dan praktisi yang berfokus pada topik "keadilan" dalam ML. Prinsip penuntunnya adalah bahwa ML harus memberi manfaat yang sama bagi semua orang, terlepas dari kategori sosial yang menyusun dan memengaruhi kehidupan kita.

Apa itu bias?

Apa konsekuensi negatif yang mungkin didapat dari penggunaan pembelajaran mesin? Jawaban singkatnya adalah: Bias.

Sebagai manusia, kita semua memiliki bias. Bias adalah alat yang digunakan otak kita untuk menangani informasi yang diberikan setiap hari.

Ini contohnya: tutup mata Anda dan gambarlah sebuah sepatu. Kemungkinan besar Anda membayangkan sneaker. Mungkin sepatu pria dari bahan kulit. Kecil kemungkinan Anda memikirkan sepatu wanita hak tinggi. Kita bahkan mungkin tidak tahu mengapa, tetapi setiap kita bias terhadap satu sepatu dibandingkan dengan sepatu lainnya.

Sekarang bayangkan Anda ingin mengajar komputer untuk mengenali sepatu. Anda mungkin akhirnya mengeksposnya pada bias Anda sendiri. Begitulah bias terjadi dalam pembelajaran mesin. Bahkan dengan niat baik, tidak mungkin memisahkan diri dari bias kita sendiri.

Tiga jenis bias

Ada berbagai cara saat bias kita sendiri berisiko menjadi bagian dari teknologi yang kita buat:

Bias interaksi

Ambil contoh sebelumnya: jika kita melatih model untuk mengenali sepatu dengan kumpulan data yang sebagian besar mencakup gambar sepatu kets, sistem tidak akan belajar mengenali sepatu hak tinggi sebagai sepatu.

Bias laten

Jika Anda melatih sistem ML tentang rupa seorang ilmuwan dengan menggunakan gambar-gambar ilmuwan terkenal dari masa lalu, algoritme Anda mungkin akan belajar mengasosiasikan ilmuwan dengan laki-laki saja.

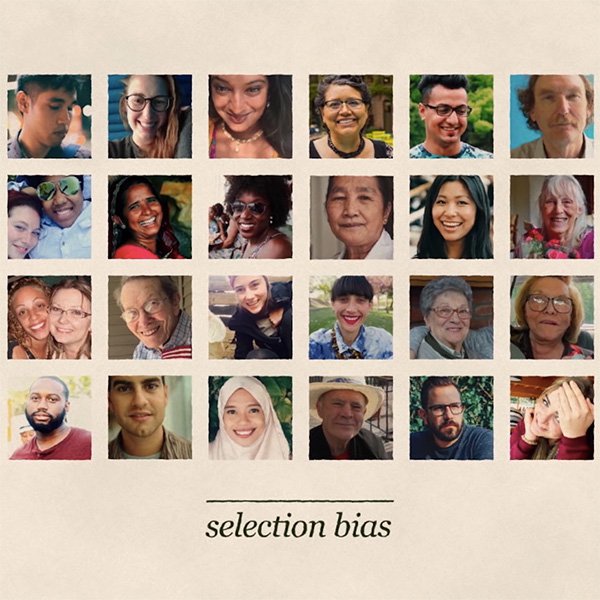

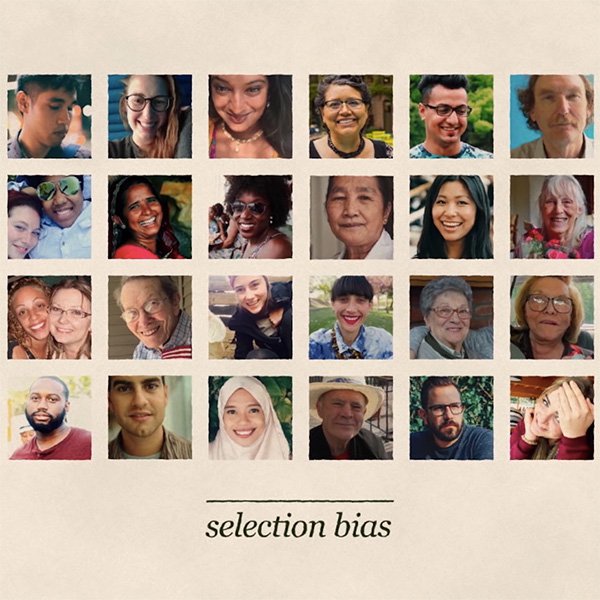

Bias seleksi

Katakanlah Anda sedang melatih model untuk mengenali wajah. Jika data yang Anda gunakan untuk melatihnya mewakili satu populasi secara berlebihan, mesin akan beroperasi lebih baik bagi mereka dengan mengorbankan yang lainnya, dengan konsekuensi yang berpotensi rasis.

Jadi apa yang bisa kita lakukan untuk menghindari bias ini?

Mengajukan pertanyaan yang tepat untuk menghindari bias

Sebagai seorang jurnalis, garis pertahanan pertama terhadap bias berada dalam jangkauan Anda: nilai-nilai dan prinsip-prinsip etika sama yang Anda terapkan setiap hari dalam profesi Anda harus diperluas untuk menilai kewajaran dari setiap teknologi baru yang ditambahkan ke kotak peralatan Anda. Pembelajaran mesin tidak terkecuali.

Selain itu, dalam semua kasus, Anda harus mulai dengan mempertimbangkan jika konsekuensinya dapat berdampak negatif terhadap ekonomi individu atau peluang kehidupan penting lainnya. Ini sangat penting terutama jika data yang Anda gunakan menyertakan informasi pribadi yang masuk akal.

Seringkali, dampak yang tidak adil tidak segera terlihat, tetapi membutuhkan pertanyaan sosial, politik, dan etika yang bernuansa tentang cara sistem pembelajaran mesin Anda memungkinkan bias masuk.

Mempertimbangkan sumber bias utama

Meskipun tidak ada data pelatihan yang benar-benar 'tidak bias', Anda dapat sangat meningkatkan peluang Anda untuk membangun model yang adil jika Anda dengan cermat mempertimbangkan sumber bias potensial dalam data Anda, dan mengambil langkah-langkah untuk mengatasinya.

Alasan paling umum untuk bias masuk adalah ketika data pelatihan Anda tidak benar-benar mewakili populasi tempat model Anda membuat prediksi. Anda harus memastikan memiliki cukup data untuk setiap grup yang relevan.

Berbagai jenis bias memanifestasikan dirinya ketika beberapa kelompok diwakili kurang positif daripada yang lain dalam data pelatihan. Anda harus mempertimbangkan meninjau data Anda sebelum menggunakannya untuk melatih suatu model, untuk memverifikasi apakah data tersebut membawa prasangka yang mungkin dipelajari dan direproduksi oleh algoritma.

Mencegah bias: dimulai dengan kesadaran

Bias dapat muncul dalam banyak cara: dari kumpulan data pelatihan, karena keputusan yang dibuat selama pengembangan sistem pembelajaran mesin, dan melalui kesimpulan umpan balik yang kompleks yang muncul ketika sistem ML digunakan di dunia nyata.

Beberapa pertanyaan konkret yang mungkin ingin Anda tanyakan untuk mengenali bias potensial meliputi:

- Untuk tujuan apa data dikumpulkan?

- Bagaimana data dikumpulkan?

- Apa tujuan menggunakan set data ini dan algoritma khusus ini?

- Bagaimana sumber data dinilai?

- Bagaimana proses analisis data didefinisikan sebelum analisis itu sendiri?

Bias adalah masalah yang kompleks dan tidak ada solusi yang ampuh untuk itu. Solusi dimulai dengan kesadaran dan kita semua harus waspada terhadap risiko itu dan mengambil langkah yang tepat untuk meminimalkannya.

-

-

Introduction to AI for News Business Teams

PelajaranLearn about Google's approach to AI and how our products can support news business teams. -